先说残差:一条抄近路的高速公路

2015 年,何凯明团队提出了 ResNet(残差网络),解决了一个深层神经网络的老大难问题:梯度消失。

网络越深,从输出层往回传递的"学习信号"就越弱,到了最前面几层,信号几乎为零——网络学不到东西了。

他们的解决方案出奇地简单:给信息开一条高速公路,让它绕过中间层,直接"跳"到后面去。

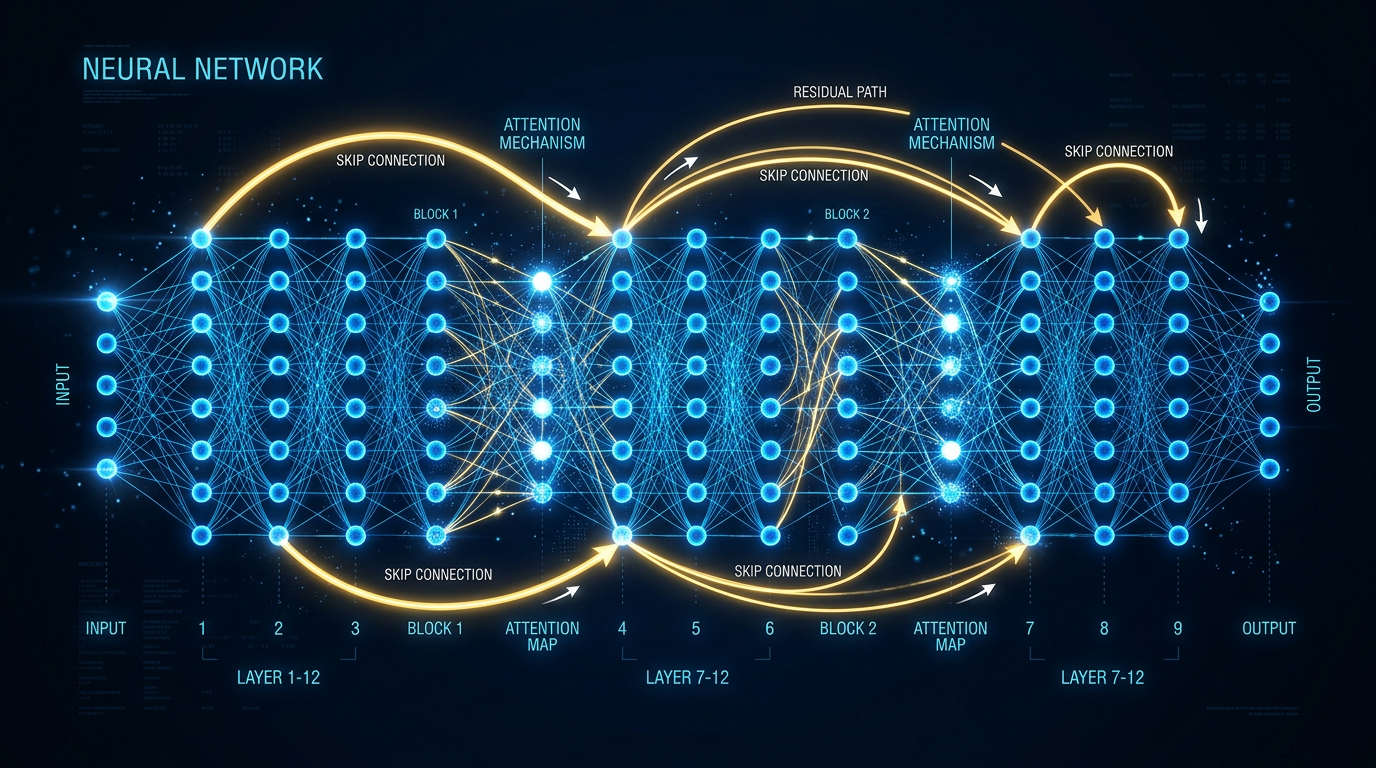

输出 = f(x) + xf(x) 是经过变换后的结果,x 是原始输入。两者相加,原始信息完整保留。这条"跳线"叫 残差连接(Residual Connection),也叫 跳跃连接(Skip Connection)。

再说注意力:模型的聚光灯

注意力机制让模型在处理一个词的时候,能"看向"句子里其他的词,判断谁跟它关系更密切。

比如"它咬了那只猫"里的"它",模型会自动关注到"狗",搞清楚"它"指的是什么。

但注意力计算本质上是一次复杂的信息重组——原来那个词的信息,会被其他词的信息"混进来"。混多了,原来的信息就模糊了。

注意力残差:专注,但不失自我

Transformer 里的标准做法是这样的:

输出 = LayerNorm(x + Attention(x))步骤拆开看:

Attention(x):用注意力机制,让当前信息与周围信息互动x + Attention(x):把注意力的结果,加回原始输入(这就是注意力残差)LayerNorm(...):做归一化,稳定数值

这个 x + 就是核心——模型在向外"看"的同时,始终保留着自己原本的身份信息。

一个生活类比

想象你是一个侦探,正在破案。

没有残差:你把所有线人的证词都吸收,最后你完全变成了证词的集合,忘了自己原本掌握的现场证据。

有残差:你听完所有证词,把它们整合进自己的判断,但你的现场证据始终握在手里。你既吸收了新信息,又没丢掉原有的依据。

注意力残差,就是那份始终握在手里的现场证据。

为什么它这么重要?

- 防止信息被"注意力淹没":残差确保原始信号不会被完全覆盖

- 梯度可以顺着残差路径直通:学习效率大幅提升

- 让深层网络可以训练:GPT-4、Llama、Claude 都是几十甚至上百层堆叠,没有残差根本训不起来

- 模型可以"选择性"跳过层:如果某层注意力没帮助,

f(x)趋向零,相当于跳过这层

总结

| 概念 | 作用 |

|---|---|

| 注意力机制 | 让模型关注句子中相关的部分 |

| 残差连接 | 保留原始信息,让梯度顺畅流动 |

| 注意力残差 | 两者结合:既专注外部关联,又不丢自身信息 |

注意力残差,是 Transformer 既能"开眼看世界"、又能"不忘自己是谁"的核心机制。

今天所有主流大语言模型,从 GPT 系列到 Llama 再到 Claude,骨子里都在用这个设计。看起来朴素,但它就是让 AI 变得"深"而不"傻"的关键所在。

本文由 Kollab AI + Claude 创作,使用半人马模式完成。