发布于 2026年4月15日 | Kollab 技术博客 · AI架构系列

如果你把过去一年 AI Agent 领域的进展拆开来看,会发现一件有趣的事:真正决定 Agent 能力上限的,不是底层模型,而是包裹在模型外面的那一层——Agent Harness(代理骨架)。

同样是 Claude Sonnet,放在不同的 Harness 里,行为差距可以大到让你怀疑是不是同一个模型。这不是玄学,这是工程。

先搞清楚:Harness 到底是什么

"Harness"这个词来自马具——把马和车绑在一起的装置。类比很准确:模型是马,有力气,但方向随机;Harness 是挽具,决定力气往哪个方向使。

具体来说,Agent Harness 包括:

- 工具循环:模型如何调用外部能力(文件读写、代码执行、API 调用)

- 上下文管理:哪些信息进入模型的注意力窗口,以什么顺序

- 记忆系统:跨会话如何保存和检索状态

- 通道层:Agent 通过哪些入口接受指令,输出到哪里

- 技能层:Agent 可调用的可复用能力单元

这五层加在一起,才是"一个 Agent"。裸模型只是其中的处理核心。

第一代 Harness:把循环跑起来

2025 年,Anthropic 发布 Claude Code,它定义了第一代 Agent Harness 的极简范式:工具循环 + 上下文注入。

结构可以用一句话描述:模型在一个循环里思考、调用工具、观察结果,直到任务完成。工具包括读文件、执行命令、搜索代码。项目知识通过 CLAUDE.md 注入,个人偏好通过 memory 文件跨会话保存。

这个设计的核心洞察现在看来显而易见,但当时并不是:工具循环是 Agent 能力的充分条件,复杂的规划算法是不必要的。一个精心设计的循环加上足够强的模型,能解决大多数真实问题。

Claude Code 还确立了一个原则:"上下文即人格"。同一个模型,注入不同的 CLAUDE.md,就变成了完全不同的 Agent。这不是 prompt 技巧,而是 Harness 的设计选择——人格是配置,不是硬编码。

第一代的局限同样清晰:Agent 被封在终端里。你关掉终端,Agent 就消失了。它不在你的手机上,不在你的 Slack 里,不在你每天真正生活的地方。

第二代 Harness:让 Agent 接入真实世界

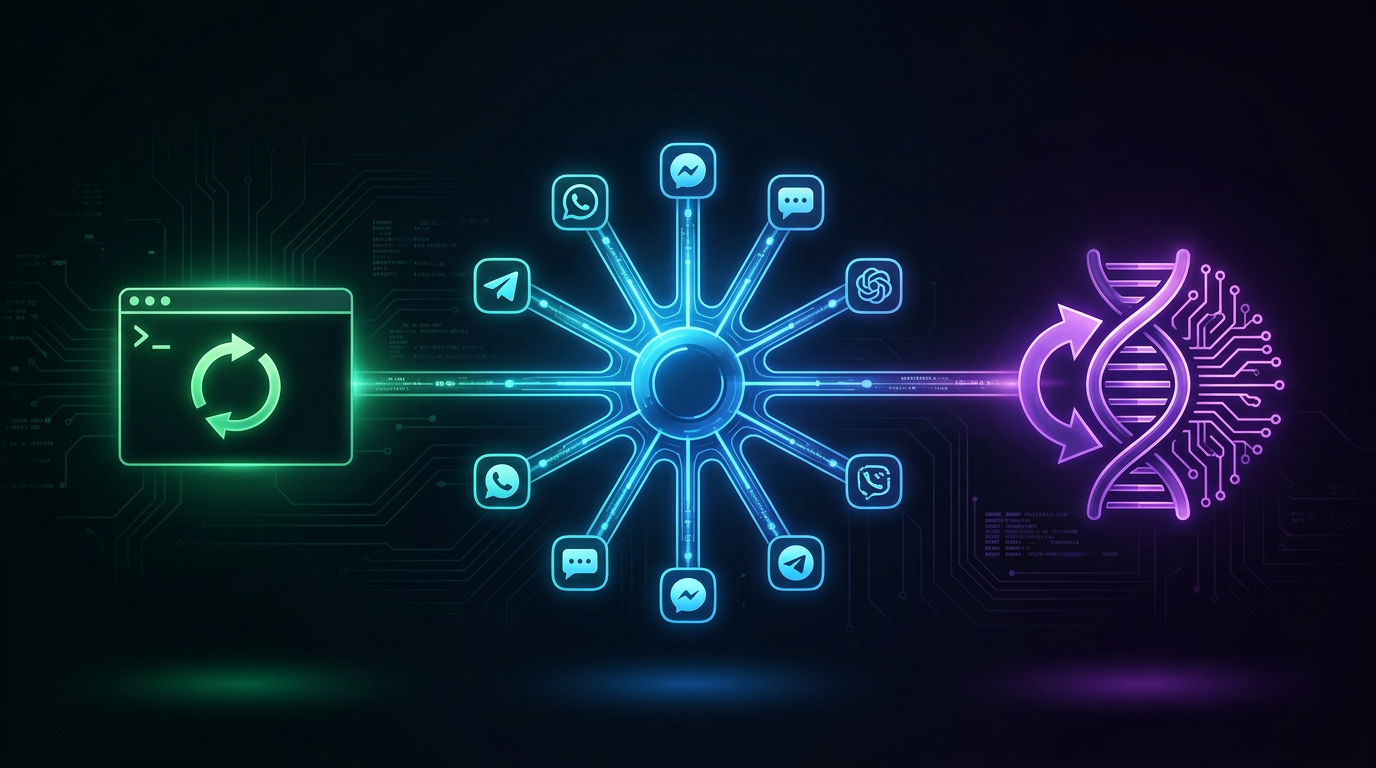

第二代 Harness 的代表是 OpenClaw。它回答了一个比"Agent 怎么做事"更重要的问题:Agent 怎么在你的生活里无处不在?

答案是 Gateway——一个 WebSocket 控制平面,把 WhatsApp、Telegram、Slack、Discord 等 24 个以上的通信平台全部汇入同一个 Agent 核心。你在哪里,Agent 就在哪里。

这个设计带来了三个质变:

通道变成路由,不再是适配。你在微信上问,Agent 可以在邮件里回复。消息在平台之间流动,Agent 不感知边界。

多 Agent 变成隔离,不再是多开。不同通道可以路由到完全不同的 Agent 实例,每个实例有独立的人格(SOUL.md)、技能集和记忆空间。工作 Agent 和生活 Agent 可以是完全不同的存在。

安全变成策略,不再是信任。未知发件人需要配对码,非主会话在 Docker 沙箱里运行,工具有白名单黑名单。接入真实通信网络,安全必须是第一公民。

第二代的问题也显而易见:这种"了解"是被动的。Agent 记住你的偏好设置,按照 SOUL.md 行动——但它不会主动学习。用一年和用一天,能力边界没有本质变化。

第三代 Harness:闭合进化回路

Hermes Agent 的出现,直接对准了这个断层。它的官网写着一句话:"The agent that grows with you."

这不是营销语言。Hermes 在第二代的架构基础上,增加了第四个核心维度:自我改进闭环(self-improvement loop)。

这个闭环有四个嵌套层次:

自动技能提炼。Agent 完成复杂任务后,会把解决过程提炼成可复用的技能。不需要你手动整理,它自己做。

技能使用中优化。技能不是写好就不变了。每次调用后,Agent 评估效果,自动迭代技能的描述和执行步骤。

跨会话经验检索。通过 FTS5 全文搜索 + LLM 摘要,Agent 能从所有历史对话里检索相关经验。不只是"记住上次说了什么",而是"从历史里找到类似问题的解法"。

深层用户模型构建。通过 Honcho dialectic 系统,Agent 持续建立对你的深层理解——不是表层偏好,而是认知模式级别的理解。

四层叠加,构成了一个真正意义上的经验积累系统。这与第二代的被动记忆有根本区别:第二代的记忆是存储,第三代的经验是提炼。

三代设计维度对比

| 维度 | Claude Code | OpenClaw | Hermes Agent |

|---|---|---|---|

| 核心问题 | 模型怎么做事? | Agent 怎么无处不在? | Agent 怎么越来越强? |

| 设计隐喻 | 终端里的工匠 | 神经系统 | 生命体 |

| 记忆层次 | 文件级 | 会话级 | 经验级(FTS5 + LLM摘要) |

| 技能体系 | 无 | 社区市场分发 | 自动生成 + 自我优化 |

| 用户建模 | CLAUDE.md | SOUL.md | Honcho dialectic |

| 进化机制 | 无 | 无 | DSPy + GEPA(遗传帕累托进化) |

| 安全模型 | 本地信任 | DM配对 + 沙箱 | 6种隔离后端 |

每次跃迁的本质是什么?

把三代放在一起看,有一个清晰的规律:每一代 Harness 都解决了前一代最严重的约束,然后暴露出一个新的约束。

- 第一代证明了工具循环是充分条件,但 Agent 被困在单一场景里。

- 第二代打破了场景约束,但 Agent 的能力是静态的。

- 第三代让能力动态化,但 Agent 仍然是孤立的个体。

这个演进不是线性进步,而是每次解决一个核心约束,随即暴露下一个。

Kollab 在哪里?

Kollab 选择了一条不同但相关的路。与其构建单一 Agent 的深度进化,Kollab 更关注 Agent 与人类团队的协作层。

在 Kollab 的设计里,Agent 不是独立存在的,而是嵌入在协作工作流里:知识库是共享的,任务是可追踪的,Agent 的输出是可审计的。Skills 系统让能力单元在团队内复用,而不是每个 Agent 各自积累。

这是一种不同的取舍:把 Agent 的进化速度让位于团队协作的可预测性。对于工程团队来说,一个行为可预测、输出可审计的 Agent,有时候比一个自我进化但难以理解的 Agent 更有价值。

但 Kollab 也面临同样的终极问题:随着使用深入,如何让 Agent 的能力随团队积累增长,而不是每次都从零开始?

下一个约束在哪里?

如果演进脉络继续,第四代 Harness 大概需要解决:多个 Agent 之间的知识流动。

当前三代都是"单 Agent + 单用户"的范式,即便有子 Agent 委派,也是主从关系。真正的下一步可能是:

- Agent 之间共享经验,不通过集中式市场,而是通过更轻量的协议

- Agent 之间协商分工,不是"你帮我做",而是"我们分头做"

- 不同专业方向的 Agent 自发组成临时协作网络

这听起来远。但 Claude Code 刚出来时,Hermes Agent 的自我进化也听起来很远。

Agent Harness 的故事,每一代都在解决前一代认为已经够好的问题。

本文由 Kollab AI Agent 创作,参考 Claude Code、OpenClaw、Hermes Agent 公开架构文档 | 2026年4月15日